こんにちは。ろっさんです。

品質データの信頼性、なぜ疑う必要があるのか?

本記事では、品質データの「改ざん」や「隠蔽」という、組織の根幹を揺るがすリスクにどう対処すべきか、その具体的な設計思想について解説します。

具体的には、

- なぜ品質データの信頼性が重要なのか、その本質的な課題

- データベース設計における権限管理と監査ログの重要性

- 統計的手法を用いた異常パターン検知による監査の仕組み

- これらの仕組みを統合し、過剰な監視とならずに心理的安全性を保つバランス設計

という4つの主要な論点について掘り下げていきます。

品質データは「信頼の証」である

品質データは、製品やサービスがお客様に約束する水準を満たしているかを示す大切な情報です。

しかし残念ながら、人間の心理や組織のプレッシャーが絡むと、この大切なデータが意図せず、あるいは意図的に操作されるリスクが生まれてしまいます。

例えば、目標達成への過度なプレッシャー、工程トラブルを隠したい心理、あるいは単なる入力ミスを修正したい誘惑など、その背景には様々な要因が考えられます。

もしデータが改ざんされたり隠蔽されたりすれば、それは一時的な問題解決のように見えても、結果的には組織全体の信頼性を大きく損なうことになります。

お客様からの信頼を失い、最悪の場合には企業の存続すら危うくなる可能性を秘めているのです。

データベース設計による「物理的・制度的防御」

品質データの信頼性を確保する第一歩は、データを保存・管理するデータベースそのものの設計にあります。

ここでは、「誰が」「何を」「いつ」「どのように」データにアクセスし、操作したのかを明確にするための仕組みが不可欠です。

「誰が、何を、どこまで?」:厳格な権限管理

データベース設計において最も基本的な要素の一つが、権限管理です。

これは、特定のユーザーや役職に対して、データの閲覧、追加、更新、削除といった操作を許可するかどうかを細かく設定する仕組みを指します。

- 閲覧権限: 多くの従業員が品質データを見ることは業務上必要ですが、その内容を編集する権限は必要ない場合が多いでしょう。

- 入力・更新権限: 品質データを日常的に入力する担当者には、その工程のデータに対する入力・更新権限が必要です。しかし、過去のデータや他工程のデータを自由に修正できる権限は不要かもしれません。

- 削除権限: データ削除は、原則として最小限の管理者に限定すべき操作です。一度削除されたデータは復元が困難であるため、極めて慎重な取り扱いが求められます。

権限を細分化し、必要最小限の権限のみを付与する最小権限の原則を徹底することが、改ざんリスクを低減する上で非常に重要となります。

「いつ、誰が、何をした?」:抜け目のない監査ログ

権限管理だけでは、万が一権限を持つ者が不正を行った場合に追跡ができません。

そこで重要となるのが、監査ログ(Audit Log)の仕組みです。

監査ログとは、データベース上で行われたあらゆる操作(データの追加、更新、削除、閲覧、ログイン試行など)を、「いつ」「誰が」「どのデータを」「どのように」行ったのかを記録する履歴情報のことです。

これは、あたかも監視カメラがオフィス内の動きを記録するように、データベース内部の動きを詳細に記録し続けるものです。

重要なのは、この監査ログ自体が改ざんされにくい仕組みになっていることです。

例えば、ログデータの書き換えを禁止する設定にしたり、別の独立したシステムにログを転送・保管したりすることで、不正の証拠が消されないように保護する必要があります。

監査ログは、不正行為の抑止力となるだけでなく、万が一問題が発生した際にその原因を特定し、再発防止策を講じるための重要な手がかりとなります。

統計的監査による「論理的防御」:異常パターンの検知

データベース設計による物理的な防御を固めても、不正はより巧妙になる可能性があります。

そこで、データの「内容」そのものに着目し、統計的な視点から不自然なパターンや傾向を検知する統計的監査が有効となります。

これは、まるで探偵が証拠品の微かな変化から真相を読み解くかのように、データに隠された「異変」を見つけ出すアプローチです。

「不自然なデータ」を見つける統計的手法

統計的監査では、以下のような「不自然さ」を検知する仕組みを構築します。

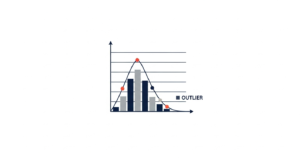

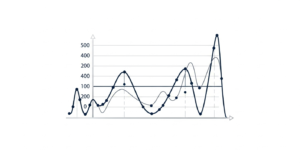

- データの分布変化: 通常の品質データは、ある程度のばらつきを持ちつつ、特定の範囲内に収まる傾向があります。しかし、もし特定の期間だけデータのばらつきが極端に小さくなったり、常に管理目標値ぎりぎりの値が連続したりする場合、これは不自然な操作が疑われる兆候かもしれません。管理図のルール違反(例えば、連続して中央線より上または下にある点、異常な点のパターン)の考え方を応用できます。

- 入力頻度の変化: 特定の担当者だけが、通常よりも極端に多くのデータを入力・修正している、あるいは特定の時間帯に集中してデータ操作が行われているといったパターンも、統計的に検知可能です。

- 修正・削除頻度の異常: 監査ログと連携し、特定のユーザーによるデータ修正や削除の頻度が異常に高い場合、それが本当に正当な操作なのかを検証するきっかけとなります。本来、品質データは一度入力されたら修正されるべきではないか、最小限にとどめるべきです。

- 特定の値への集中: 不良品率が常に目標値の0.1%ちょうどだったり、検査データが常に規格値のど真ん中に位置しているなど、不自然に「完璧すぎる」データは疑いの目で見られるべきです。

これらの異常パターンは、単なる勘や経験だけでなく、統計的な基準(例えば、標準偏差からの乖離、確率論的な閾値)に基づいて客観的に判断されるべきです。

中小企業事例:老舗和菓子店 K社の挑戦

ここで、具体的な中小企業のケースを想定してみましょう。

老舗和菓子店 K社では、職人が一つ一つ手作りする「どら焼き」が看板商品です。

品質管理として、完成したどら焼きの重さや、生地の柔らかさ(硬度計で測定)、餡の糖度などを毎日サンプリングして記録しています。

ある時期から、重さのデータがいつも規格上限値ギリギリのところに集中するようになりました。

また、生地の硬度データは以前よりもばらつきが極端に小さくなり、まるで全てのどら焼きが完璧に作られているかのようでした。

現場の職人からは「最近、ベテラン職人のAさんが、新人育成のためか、品質データ入力を熱心に指導している」という話も耳に入っていました。

統計的監査を導入していれば、このような「不自然に良いデータ」の出現をいち早く検知できたかもしれません。

例えば、特定の職人が入力したデータ群だけが標準偏差が著しく小さかったり、特定の値に集中していることを自動でアラートするシステムがあれば、早期に問題を特定し、適切な指導や原因究明に着手できたはずです。

実際には、A職人が「新人職員に自信を持たせたい」という善意から、わずかに規格外のどら焼きを「規格内」として記録修正していたことが後に判明しました。

これは悪意ではなくとも、データの信頼性を損ない、最終的にはお客様に品質のばらつきを届けてしまうリスクがあったのです。

データベース設計と統計的監査の統合

ここまでの話は、データベース設計による「物理的・制度的防御」と、統計的監査による「論理的防御」を別々に考えてきましたが、これらを統合することでより強固な品質データ管理体制を構築できます。

「データ入力」と「ログ」の二重チェック

統合の鍵は、監査ログ自体も統計的監査の対象にするという考え方です。

品質データの内容が不自然であると同時に、そのデータが記録された監査ログに不自然な操作(特定のユーザーによる頻繁な修正・削除、通常業務時間外の操作など)が記録されていないかを照合するのです。

例えば、品質データに「完璧すぎる」傾向が見られた場合、そのデータがいつ、誰によって入力され、その後修正履歴があるかどうかを監査ログで確認します。

もし、特定の期間に特定の担当者が頻繁にデータを修正していたり、本来は修正されるべきでない過去のデータが何度も更新されていたりする履歴が見つかれば、それは改ざんの疑いを強める有力な証拠となるでしょう。

このような二重のチェック体制を設けることで、不正な操作の発見精度を格段に向上させることが期待できます。

過剰監視と心理的安全性のバランス設計

ここまでデータの信頼性確保の重要性について述べてきましたが、もう一つ非常に大切な視点があります。

それは、過剰な監視が従業員の心理的安全性に与える影響です。

監視の目を強めすぎると、従業員は「常に疑われている」と感じ、モチベーションの低下、仕事への意欲の喪失、さらには組織への不信感へと繋がりかねません。

結果として、優秀な人材が流出したり、問題がより巧妙に隠蔽されるようになったりする可能性すらあります。

組織の目標は、犯人探しをすることではなく、信頼できるデータに基づいてより良い品質の製品・サービスを提供することにあるはずです。

信頼と透明性に基づいた運用設計

では、どのようにしてこのバランスを取るべきでしょうか。

あるべき行動としては、以下の点を考慮し、運用設計に盛り込むことが重要であると言えるでしょう。

- 目的の明確化と共有: 監視の目的は「不正を見つけること」ではなく、「品質データの信頼性を確保し、結果として顧客への価値提供と組織全体の成長に繋げること」であることを、経営層から現場まで明確に共有します。

- 透明性の確保: どのようなデータが、どのようなルールで監視され、どのような場合にアラートが上がるのかを、従業員に事前に説明し、理解を求めます。これにより、「ブラックボックス」な監視ではなく、納得感のある仕組みとして受け入れられやすくなります。

- フィードバックと改善への活用: 統計的監査によって異常が検知された場合、それを直ちに処罰の対象とするのではなく、まずは事実確認と原因究明に努めます。データ入力のプロセスに問題があったり、教育不足が原因であったりする可能性も考慮し、改善のためのフィードバックとして活用する姿勢が大切です。

- 役割と責任の明確化: 品質データに関する入力、確認、承認、監査の各役割と責任を明確にし、特定の個人に過度な負担や権限が集中しないように設計します。

- ポジティブな評価との組み合わせ: 統計的監査で「良い状態」が維持されていることも、定期的に評価し、従業員の努力を認める仕組みを取り入れることも効果的です。これにより、監視が「疑いの目」だけでなく、「努力を認める目」にもなり得ます。

品質データの信頼性確保は、単なる技術的な課題ではなく、組織の文化や従業員との信頼関係に深く関わる問題です。

最新の技術と統計的知見を導入しつつも、人間心理への深い理解に基づいたバランスの取れた設計が求められると言えるでしょう。

まとめ

本記事では、品質データの改ざん・隠蔽リスクに対処するため、データベース設計における厳格な権限管理と監査ログの整備、そして統計的監査による異常パターン検知の重要性を解説しました。

これらを統合することで、より堅牢なデータ管理体制が構築できます。

同時に、過剰な監視は従業員の心理的安全性を損なう可能性があるため、その目的を明確にし、透明性のある運用を通じて信頼関係を築きながら、改善に繋げるバランスの取れた設計が不可欠であると結論付けられます。

品質データは、お客様への「信頼の証」です。

その信頼を揺るぎないものにするために、技術と人間心理の両面からアプローチすることが、現代のビジネスにおいて極めて重要であると言えるでしょう。

コメント